Actu

IA: Des leaders de l'industrie mettent en garde contre un risque existentiel pour l'humanité

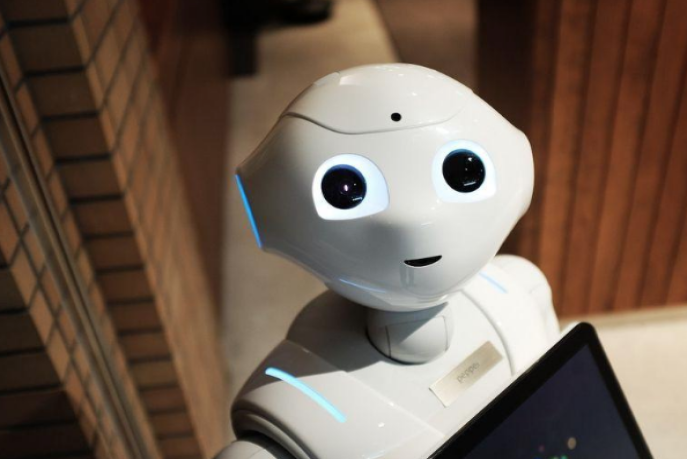

Il a l’air gentil comme ça, mais ce robot et l’Intelligence artificielle qu’il symbolise fraient courir à l’humanité un risque d’extinction

Washington - Des dizaines de leaders de l'industrie de l'intelligence artificielle (IA), d'universitaires et même des célébrités ont appelé mardi à réduire le risque d'"extinction" posé à l'humanité dû à l'intelligence artificielle.

Dans une déclaration laconique publiée mardi, ces personnalités ont souligné que le risque d'extinction lié à l'IA devrait être une priorité mondiale absolue.

"Atténuer le risque d'extinction de l'IA devrait être une priorité mondiale aux côtés d'autres risques à l'échelle de la société tels que les pandémies et la guerre nucléaire", lit-on dans la déclaration publiée par l'ONG américaine Center for AI Safety.

La déclaration a été signée par les principaux responsables de l'industrie, dont le PDG d'OpenAI Sam Altman, le "parrain" de l'IA Geoffrey Hinton, des cadres supérieurs et des chercheurs de Google DeepMind et Anthropic, Kevin Scott, directeur de la technologie de Microsoft, Bruce Schneier, le pionnier de la sécurité Internet et de la cryptographie et le défenseur du climat Bill McKibben.

Le document souligne les préoccupations de grande envergure concernant le danger ultime d'une intelligence artificielle incontrôlée.

Les experts en intelligence artificielle ont affirmé que la société était encore loin de développer le type d'intelligence artificielle générale qui relève de la science-fiction ; les chatbots de pointe d'aujourd'hui reproduisent en grande partie des modèles basés sur des données de formation qui leur ont été fournies et ne pensent pas par eux-mêmes.

Pourtant, les flux des investissements dans l'industrie de l'IA ont conduit à des appels à la réglementation, avant que des accidents majeurs ne se produisent.

Cette déclaration fait suite au succès viral du ChatGPT d'OpenAI. Un nombre croissant de parlementaires, de groupes de défense et d'experts de la technologie ont sonné l'alarme quant au potentiel d'une nouvelle génération de chatbots alimentés par l'IA qui risque de propager la désinformation et de supprimer des emplois.

Hinton, dont le travail de pionnier a contribué à façonner les systèmes d'IA d'aujourd'hui, avait précédemment déclaré à CNN qu'il avait décidé de quitter son poste chez Google et de "dénoncer" la technologie après avoir "soudainement" réalisé "que ces choses deviennent plus intelligentes que nous".

Dan Hendrycks, directeur du Center for AI Safety, a affirmé mardi dans un tweet que la déclaration proposée pour la première fois par David Kreuger, professeur d'IA à l'Université de Cambridge, n'empêche pas la société de traiter d'autres types de risques liés à l'IA, tels que le biais algorithmique ou la désinformation.